Hoy, las noticias más relevantes proceden de Irán.

Una nueva era de la guerra está emergiendo a un ritmo que parece casi irreal, con algoritmos que ahora modelan el tempo y la escala de la acción militar de formas que antes estaban reservadas a la ciencia ficción. Sin embargo, bajo el espectáculo del poder tecnológico subyacen riesgos no resueltos que desafían supuestos arraigados sobre el control y la responsabilidad.

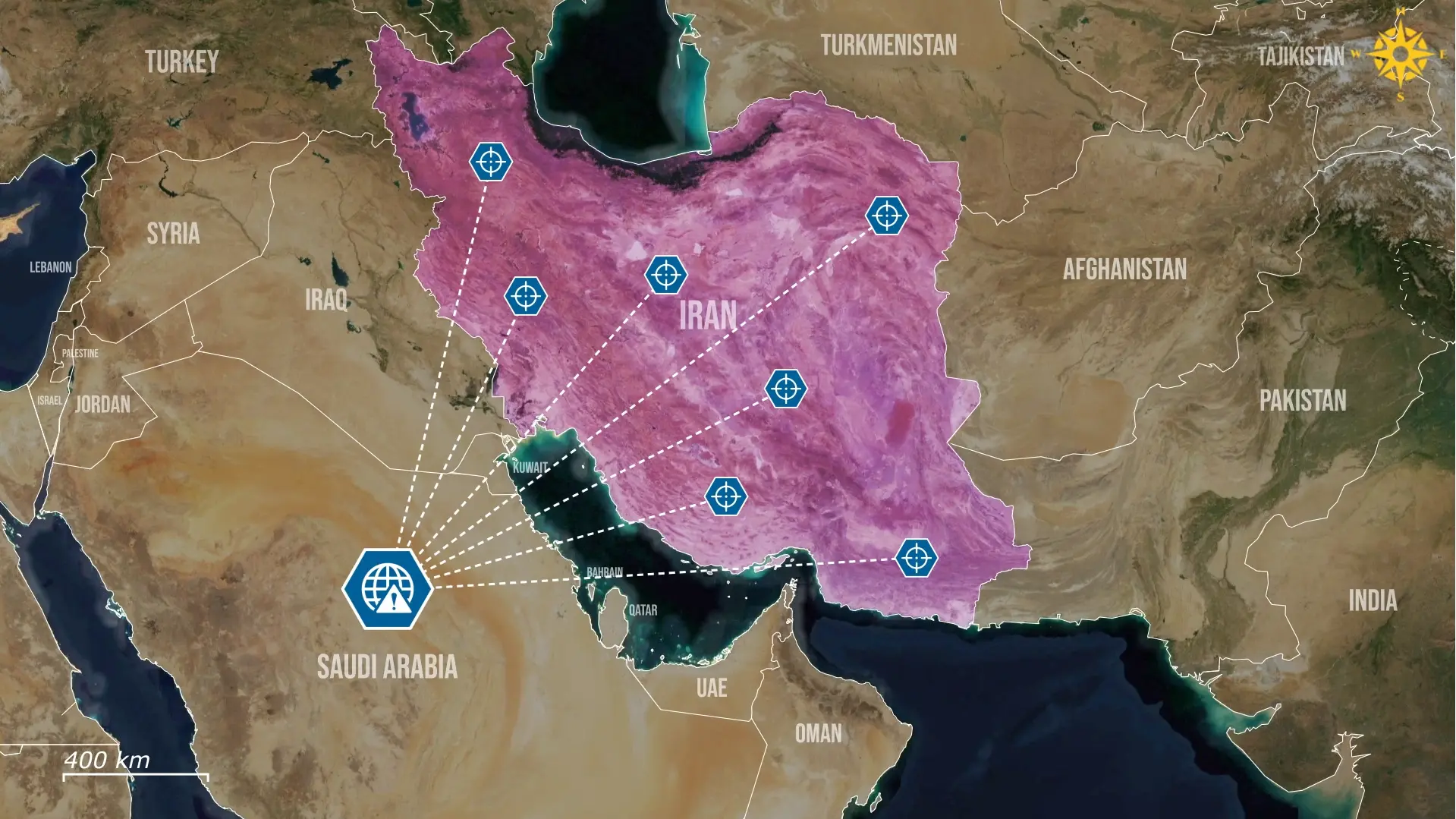

Estados Unidos empleó una arquitectura de fijación de objetivos integrada e impulsada por inteligencia artificial para identificar y atacar aproximadamente 1.000 objetivos en Irán durante las primeras 24 horas del conflicto. Una escala de acción similar habría requerido anteriormente semanas de trabajo de Estado Mayor y prolongados ciclos analíticos.

Esta asombrosa aceleración fue posible gracias al acoplamiento del Maven Smart System para vigilancia con el modelo de IA Claude de Anthropic. Juntos, procesaron insumos de inteligencia y produjeron listas de objetivos priorizados a un ritmo sin precedentes.

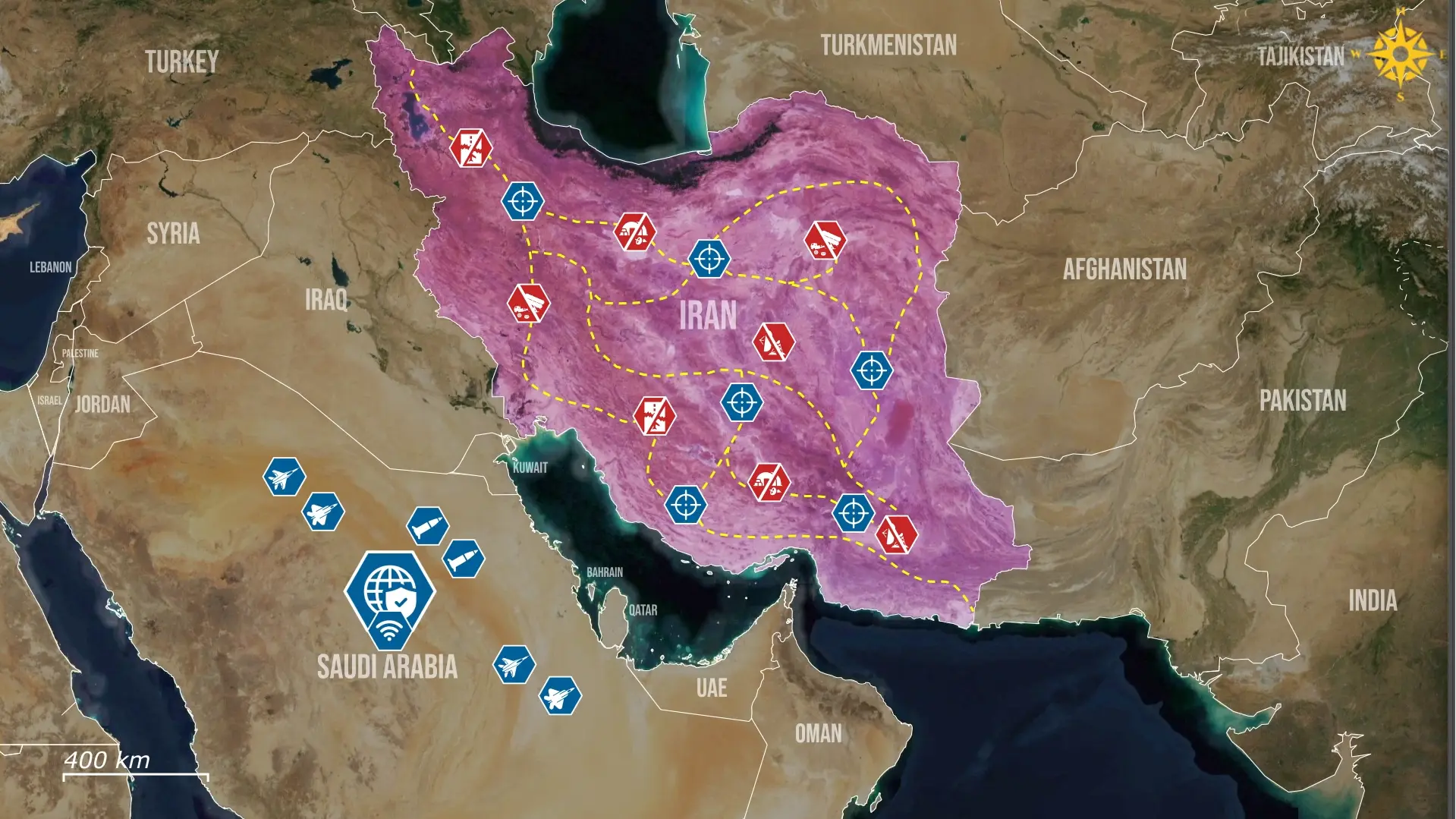

El resultado fue una cadena de montaje de ataques que comprimió la cadena de letalidad tradicional y permitió a Estados Unidos desbordar las defensas iraníes antes de que pudieran articular una respuesta rápida y eficaz.

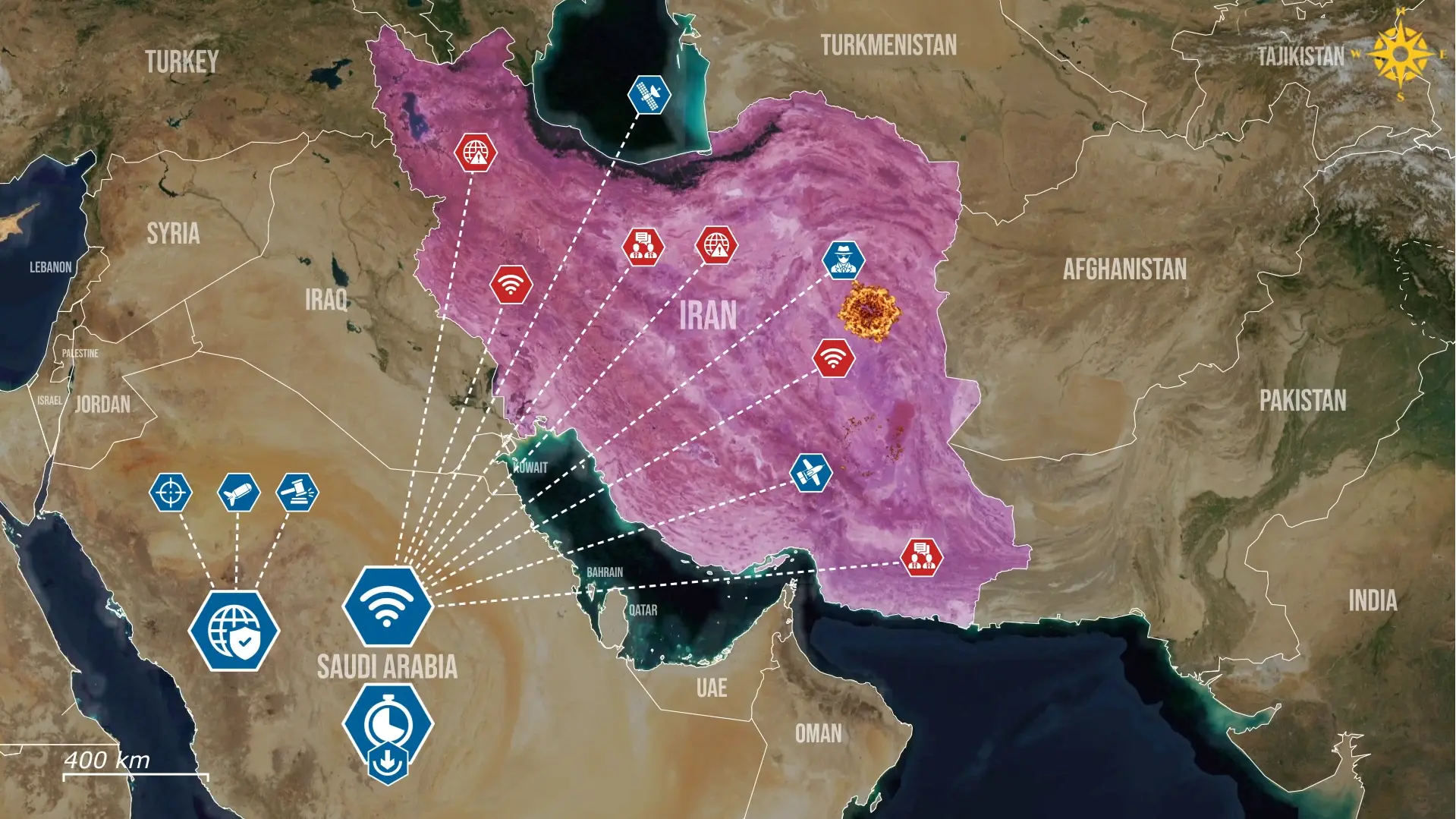

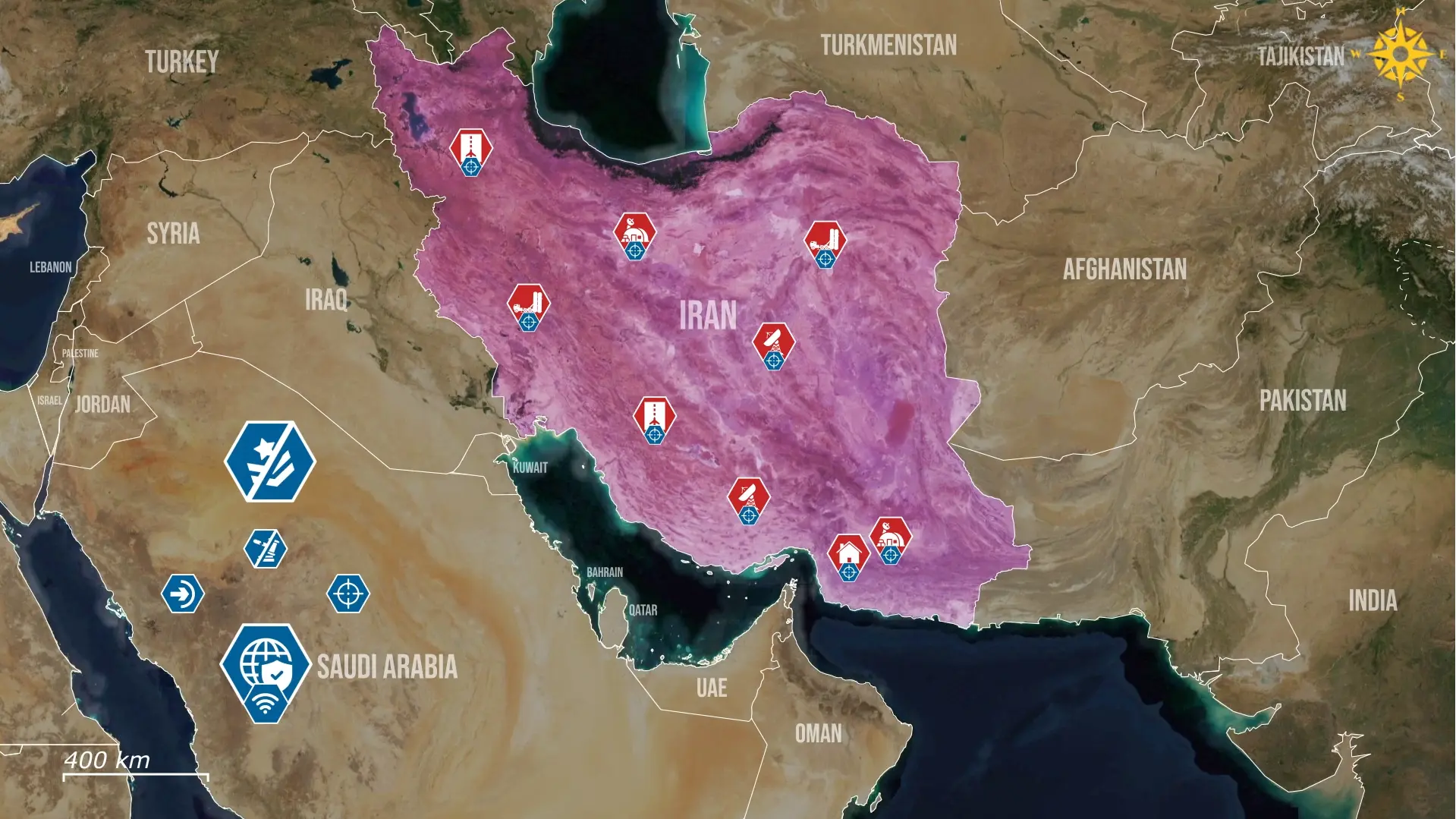

La plataforma Maven funciona como un agregador, recopilando flujos de datos de satélites y drones, así como datos de inteligencia adicionales procedentes de llamadas telefónicas, correos electrónicos y otras comunicaciones electrónicas. Posteriormente, Maven convierte los flujos de datos recibidos en información estructurada y coherente. En este punto, el modelo Claude sintetiza este material en productos operacionalmente utilizables, incluyendo coordenadas, armamento recomendado e incluso justificaciones legales alineadas con el derecho de la guerra. Este flujo de trabajo reduce el tiempo requerido por los analistas humanos para interpretar la inteligencia bruta y transforma los flujos de datos en un flujo constante de paquetes de objetivos preparados que pueden ejecutarse de forma casi inmediata.

La integración de la IA en la fijación de objetivos ofrece ventajas tácticas que redefinen la guerra. La primera ventaja notable es la escala de los objetivos disponibles, ya que la fijación de objetivos por IA puede procesar datos mucho más rápido que los humanos. Esto, a su vez, permite una alta tasa de ataques que sería imposible solo con el análisis humano. Además, el sistema integrado por IA ofrece una mayor profundidad de los ataques disponibles al identificar rápidamente no solo los activos militares, sino también los logísticos que podrían no ser evidentes a pesar de su importancia. Estas ventajas cambian la guerra considerablemente, ya que para un ejército como el de EE. UU., el factor limitante ya no es el procesamiento de inteligencia sino la capacidad de lanzar y sostener ataques.

Aunque el Pentágono declara formalmente que los seres humanos conservan el poder de decisión final, el ritmo de las propuestas de objetivos generadas por máquinas está empujando el proceso de toma de decisiones hacia la dependencia del algoritmo de IA. De hecho, aunque los oficiales actúan oficialmente todavía como revisores finales que aprueban o deniegan ataques, pueden verse confrontados con cientos de objetivos validados por la IA.

Al mismo tiempo, se verán presionados para actuar rápidamente antes de que el enemigo pueda reaccionar. Como resultado, las funciones de los oficiales se limitan cada vez más a confirmar muchos objetivos propuestos en lugar de realizar una evaluación personal, humana y matizada.

Sin embargo, aunque la IA procesa la información más rápido que los humanos, no es inherentemente más inteligente, y puede malinterpretar patrones o clasificar erróneamente estructuras civiles situadas cerca de activos militares. Por ejemplo, los informes sugieren que una identificación errónea generada por IA puede haber contribuido al bombardeo de una escuela de niñas junto a posiciones militares iraníes en la ciudad de Minab. La posibilidad de que un algoritmo pudiera haber marcado el sitio como un almacén o un nodo de mando subraya el riesgo estructural creado cuando la supervisión humana se convierte en poco más que un formalismo. Los errores también se propagan rápidamente a través de los sistemas automatizados, especialmente en operaciones dependientes de la velocidad donde la presión para aprobar objetivos es alta. Por lo tanto, mantener una revisión humana rigurosa es esencial para evitar que la clasificación errónea se convierta en una característica intrínseca del ciclo de fijación de objetivos.

En general, la integración de la IA en la guerra está reformando el equilibrio entre velocidad, precisión y rendición de cuentas, creando un sistema que puede producir efectos a gran escala con una intervención humana mínima. Esta transformación ofrece beneficios operativos claros, pero también introduce nuevas vulnerabilidades vinculadas a la clasificación errónea, la excesiva confianza y la dilución del juicio humano. El desafío central será diseñar mecanismos de supervisión que sigan el ritmo de los ciclos de decisión automatizados en lugar de quedar rezagados respecto a ellos. Esto adquiere una importancia creciente a medida que los ejércitos expanden el uso de la IA en más dominios y la responsabilidad legal se difumina.

.jpg)

Comentarios