Aujourd’hui, les informations les plus marquantes proviennent d’Iran.

Une nouvelle ère de la guerre émerge à un rythme qui semble presque irréel, avec des algorithmes modélisant désormais le tempo et l'ampleur de l'action militaire d'une manière autrefois réservée à la science-fiction. Cependant, derrière le spectacle de la puissance technologique se cachent des risques non résolus qui remettent en question des hypothèses de longue date sur le contrôle et la responsabilité.

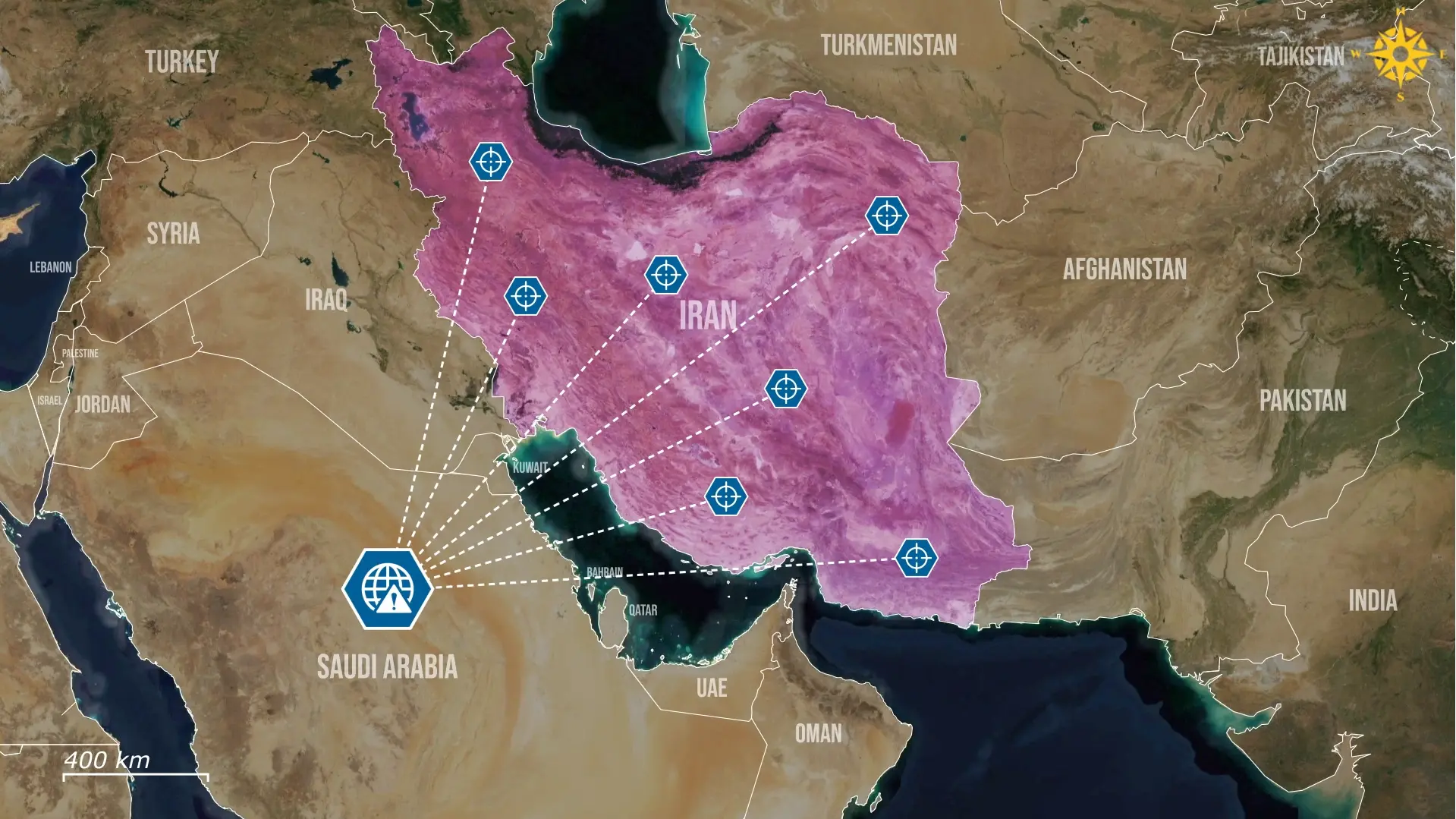

Les États-Unis ont utilisé une architecture de ciblage intégrée, pilotée par l'intelligence artificielle, pour identifier et frapper environ 1 000 cibles en Iran au cours des premières 24 heures du conflit. Une telle envergure d'action aurait auparavant nécessité des semaines de travail d'état-major et de longs cycles d'analyse.

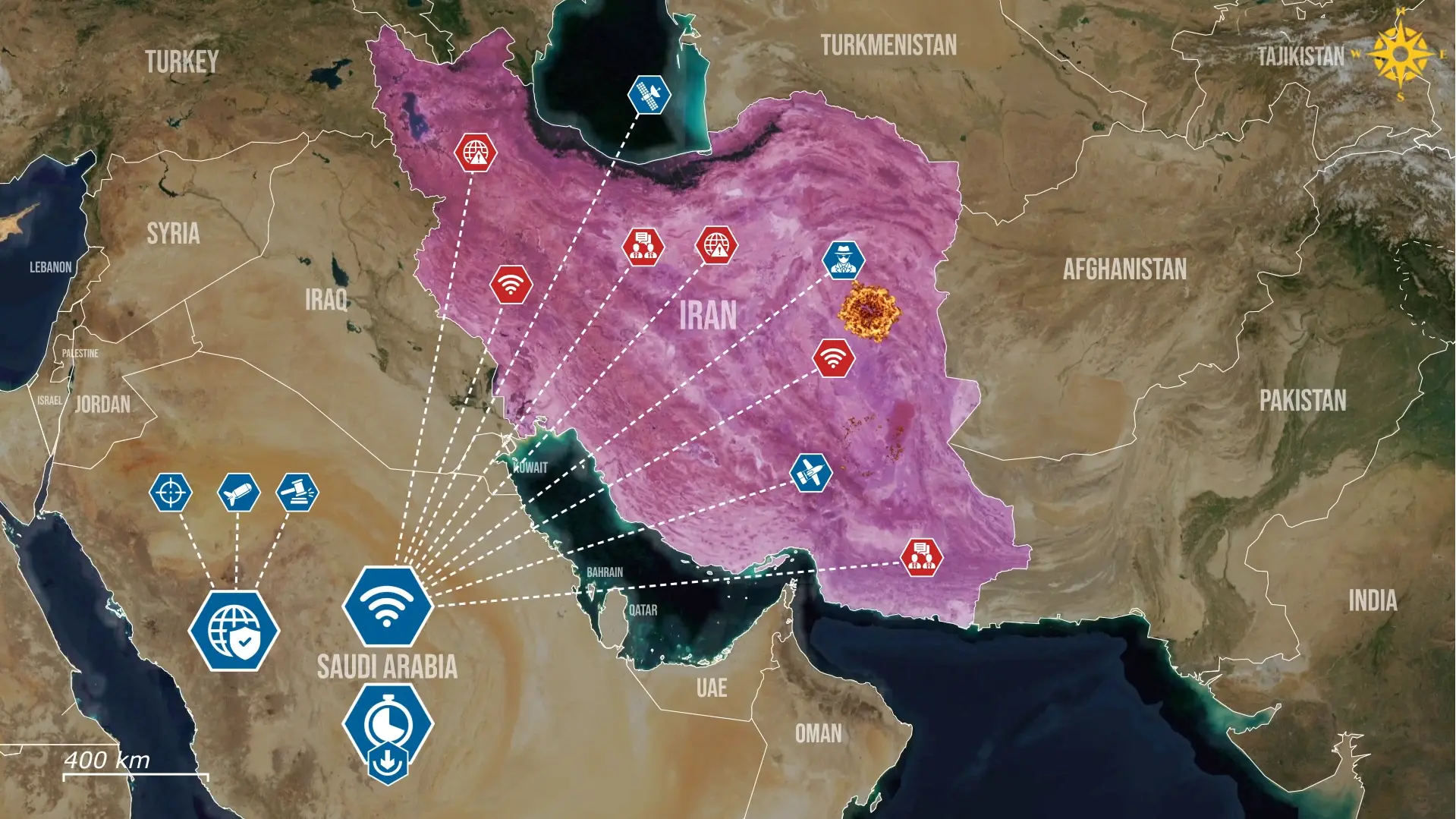

Cette accélération stupéfiante a été rendue possible par le couplage du système de surveillance Maven Smart System avec le modèle d'IA Claude d'Anthropic. Ensemble, ils ont traité les données de renseignement et produit des listes de cibles prioritaires à un rythme sans précédent.

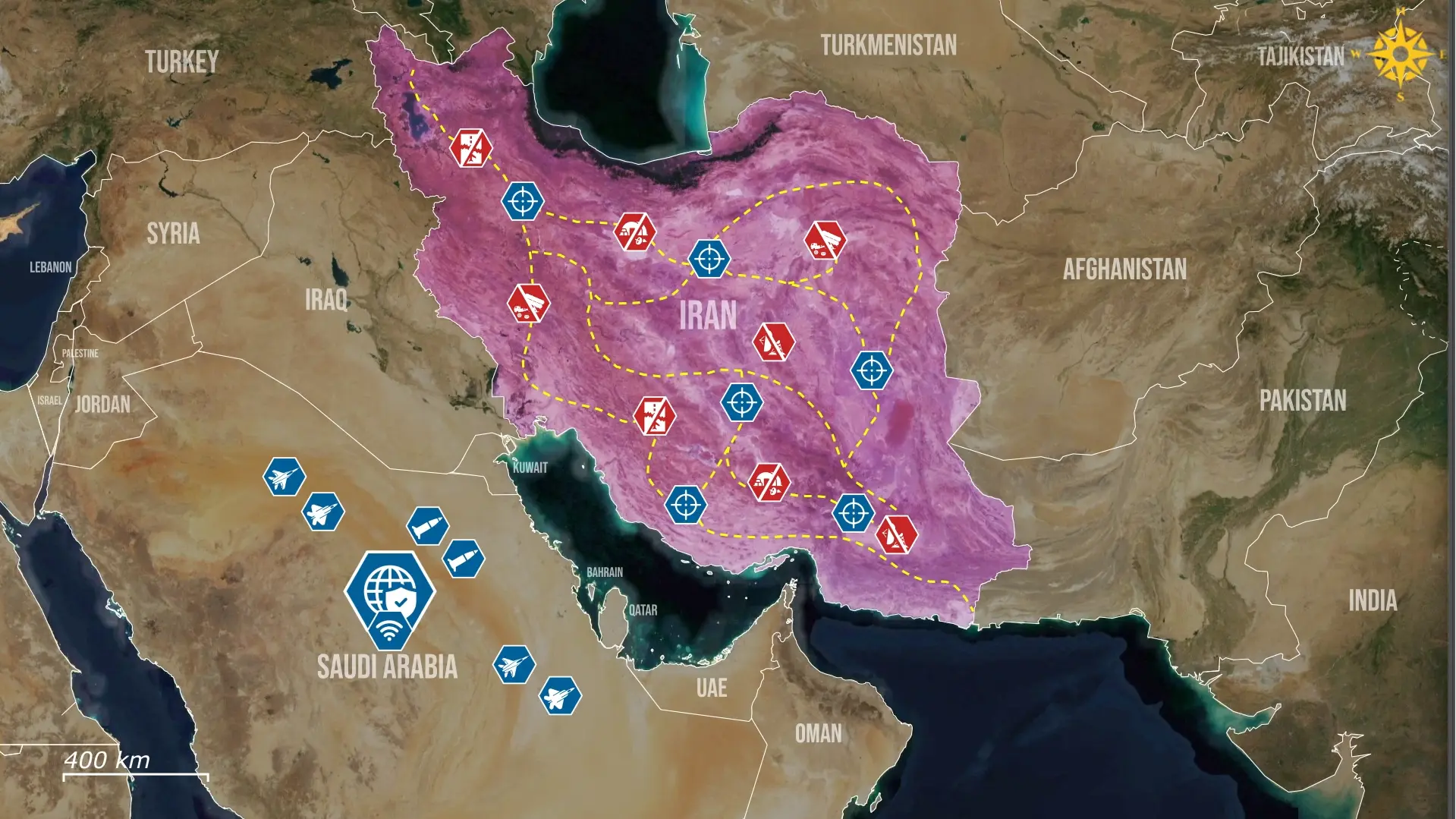

Le résultat a été une véritable chaîne de montage de frappes qui a compressé la chaîne de destruction traditionnelle et a permis aux États-Unis de submerger les défenses iraniennes avant qu'elles ne puissent organiser une riposte rapide et efficace.

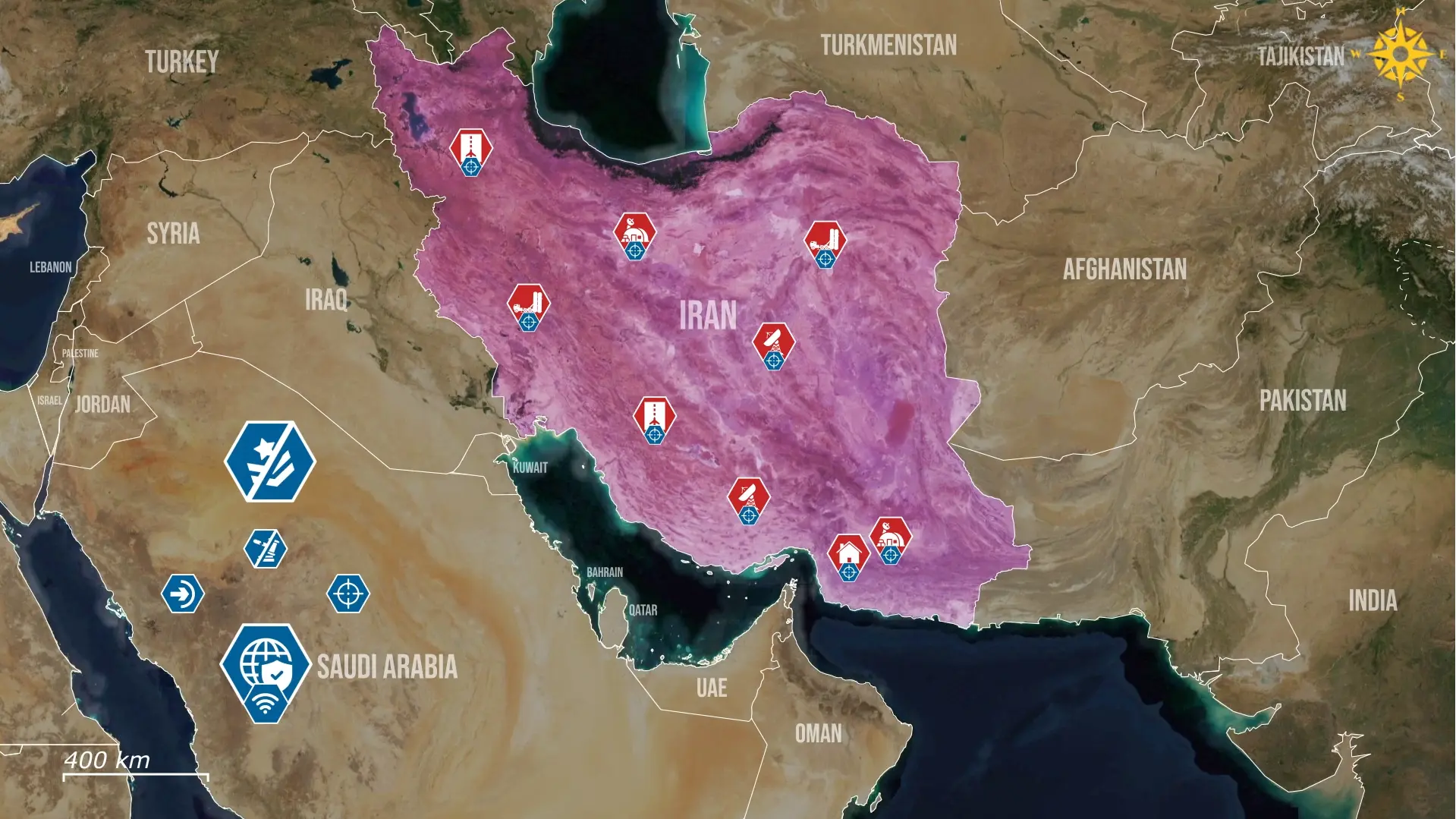

La plateforme Maven fonctionne comme un agrégateur, collectant des flux de données provenant de satellites et de drones, ainsi que des renseignements supplémentaires issus d'appels téléphoniques, de courriels et d'autres communications électroniques. Ensuite, Maven convertit ces flux de données reçus en informations structurées et cohérentes. À ce stade, le modèle Claude synthétise ce matériel en produits opérationnels utilisables, incluant des coordonnées, des recommandations d'armement et même des justifications juridiques alignées sur le droit de la guerre. Ce flux de travail réduit le temps nécessaire aux analystes humains pour interpréter le renseignement brut et transforme les flux de données en un flux constant de dossiers de ciblage prêts à l'emploi, pouvant faire l'objet d'une action presque immédiate.

L'intégration de l'IA dans le ciblage offre des avantages tactiques qui redéfinissent la guerre. Le premier avantage notable réside dans le volume des cibles disponibles, le ciblage par IA pouvant traiter les données bien plus rapidement que les humains. Cela permet, en retour, un taux de frappe élevé qui serait impossible avec la seule analyse humaine. De plus, le système intégré à l'IA offre une plus grande profondeur de frappe en identifiant rapidement non seulement les actifs militaires, mais aussi les actifs logistiques qui pourraient ne pas être immédiatement apparents malgré leur importance. Ces avantages modifient considérablement la guerre car, pour une armée comme celle des États-Unis, le facteur limitant n'est plus le traitement du renseignement, mais la capacité à lancer et à soutenir les frappes.

Bien que le Pentagone affirme formellement que l'humain conserve le pouvoir de décision final, la cadence des propositions de ciblage générées par machine pousse le processus décisionnel vers une dépendance à l'algorithme d'IA. En fait, alors que les officiers agissent officiellement toujours comme examinateurs finaux approuvant ou refusant les frappes, ils peuvent être confrontés à des centaines de cibles validées par l'IA.

Dans le même temps, ils seront pressés d'agir rapidement avant que l'ennemi ne puisse réagir. Par conséquent, le rôle des officiers se limite de plus en plus à confirmer de nombreuses cibles proposées plutôt qu'à effectuer une évaluation personnelle, humaine et nuancée.

Cependant, bien que l'IA traite l'information plus rapidement que les humains, elle n'est pas intrinsèquement plus intelligente et peut mal interpréter des schémas ou classer de manière erronée des structures civiles situées à proximité d'actifs militaires. Par exemple, des rapports suggèrent qu'une erreur d'identification générée par l'IA pourrait avoir contribué au bombardement d'une école de filles adjacente à des positions militaires iraniennes dans la ville de Minab. La possibilité qu'un algorithme ait pu signaler le site comme un entrepôt ou un nœud de commandement souligne le risque structurel créé lorsque la supervision humaine ne devient guère plus qu'une formalité. Les erreurs se propagent également rapidement à travers les systèmes automatisés, en particulier dans les opérations reposant sur la vitesse où la pression pour approuver les cibles est élevée. Le maintien d'un examen humain rigoureux est donc essentiel pour éviter que la mauvaise classification ne devienne une caractéristique intrinsèque du cycle de ciblage.

Globalement, l'intégration de l'IA dans la guerre réforme l'équilibre entre vitesse, précision et responsabilité, créant un système capable de produire des effets à grande échelle avec une intervention humaine minimale. Cette transformation offre des bénéfices opérationnels clairs, mais elle introduit également de nouvelles vulnérabilités liées à la mauvaise classification, à l'excès de confiance et à la dilution du jugement humain. Le défi central consistera à concevoir des mécanismes de surveillance qui suivent le rythme des cycles de décision automatisés plutôt que d'être à la traîne. Cela devient d'autant plus crucial que les armées étendent l'usage de l'IA à davantage de domaines et que la responsabilité juridique s'estompe.

.jpg)

Commentaires