Dzisiaj najważniejsze wiadomości napływają z Iranu.

Nowa era prowadzenia działań wojennych wyłania się w tempie, które wydaje się niemal nierealne, a algorytmy modelują obecnie dynamikę i skalę operacji militarnych w sposób zarezerwowany niegdyś dla literatury science-fiction. Jednak pod powierzchnią spektaklu technologicznej potęgi kryją się nierozwiązane ryzyka, które podważają dotychczasowe założenia dotyczące kontroli i odpowiedzialności.

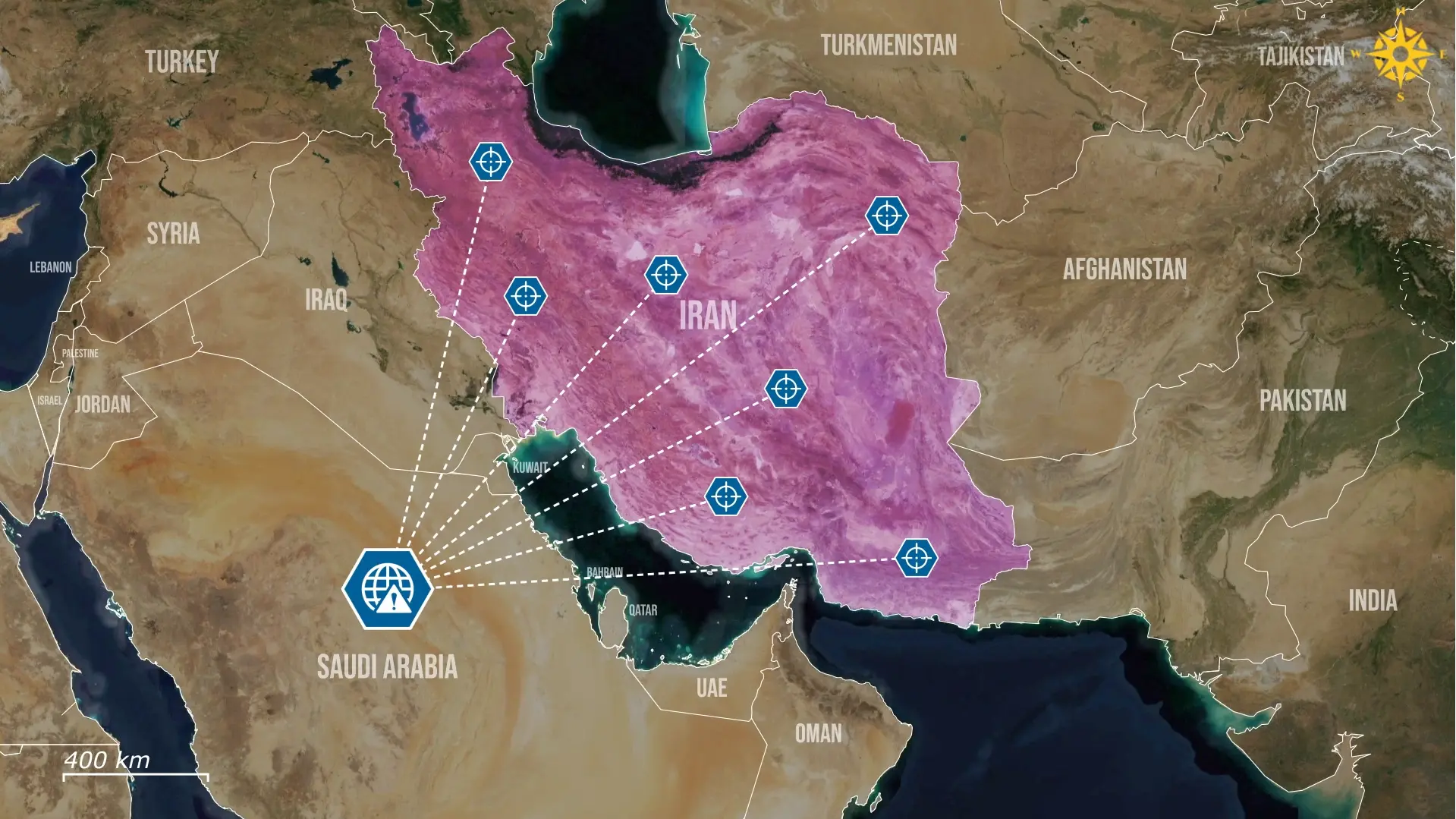

Stany Zjednoczone wykorzystały zintegrowaną architekturę wskazywania celów opartą na sztucznej inteligencji, aby zidentyfikować i uderzyć w około 1000 celów w Iranie w ciągu pierwszych 24 godzin konfliktu. Skala działań tego rzędu wymagałaby wcześniej tygodni pracy sztabowej i długotrwałych cykli analitycznych.

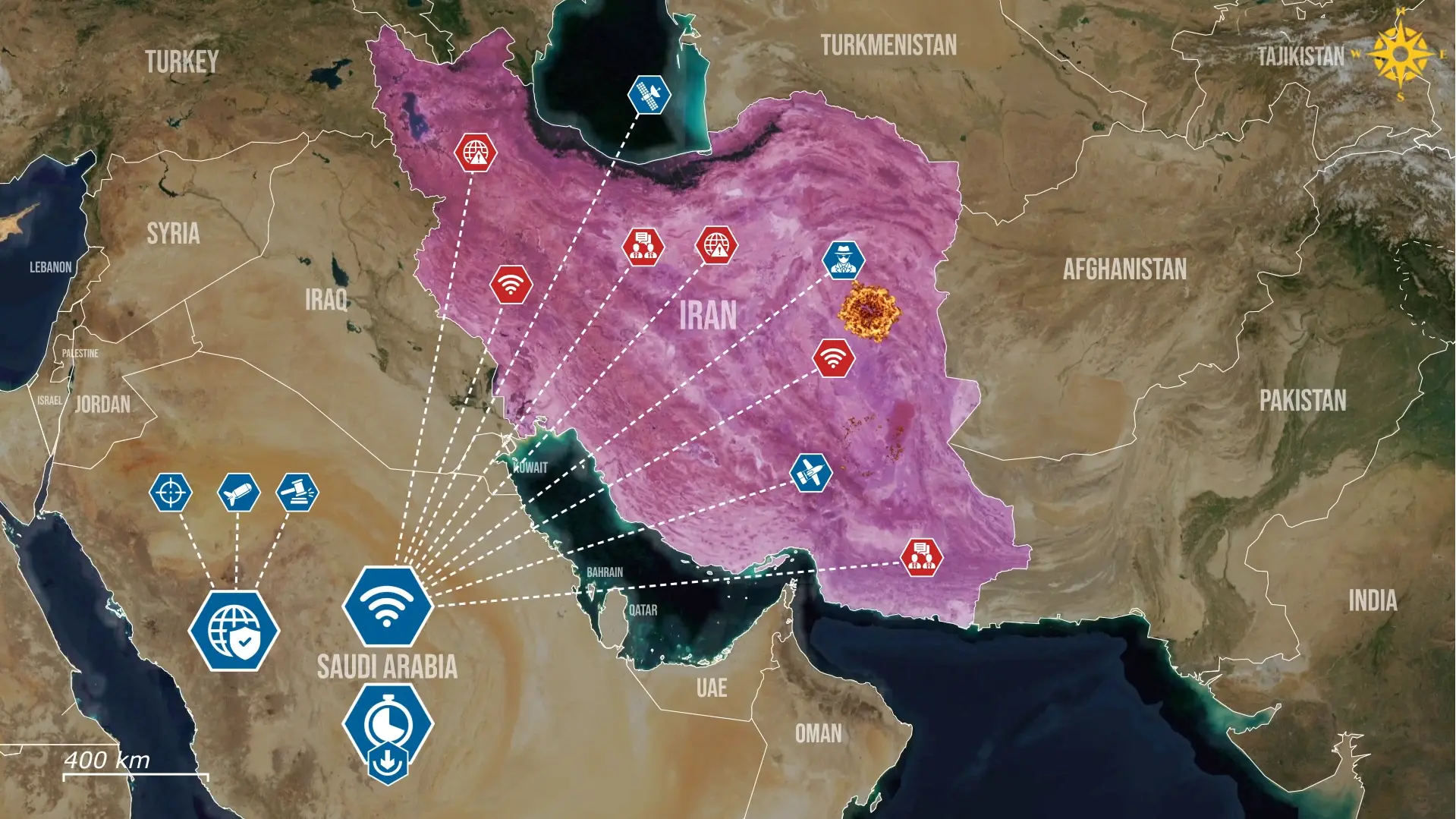

To zdumiewające przyspieszenie było możliwe dzięki połączeniu systemu dozoru Maven Smart System z modelem sztucznej inteligencji Claude firmy Anthropic. Wspólnie przetworzyły one dane wywiadowcze i wygenerowały priorytetowe listy celów w bezprecedensowym tempie.

Rezultatem był taśmociąg uderzeń, który skrócił tradycyjny łańcuch rażenia i pozwolił Stanom Zjednoczonym obezwładnić irańską obronę, zanim ta była w stanie zorganizować szybką i skuteczną odpowiedź.

Platforma Maven działa jako agregator, gromadząc strumienie danych z satelitów i dronów, a także dodatkowe informacje wywiadowcze z połączeń telefonicznych, poczty elektronicznej i innej komunikacji elektronicznej. Następnie Maven konwertuje otrzymane dane na ustrukturyzowane, spójne informacje. Na tym etapie model Claude syntetyzuje ten materiał w operacyjnie użyteczne produkty, w tym współrzędne, rekomendowane rodzaje uzbrojenia, a nawet uzasadnienia prawne zgodne z prawem konfliktów zbrojnych. Taki obieg pracy skraca czas potrzebny ludzkim analitykom na interpretację surowych danych wywiadowczych i przekształca strumienie danych w stały dopływ gotowych pakietów celowniczych, które mogą zostać zrealizowane niemal natychmiast.

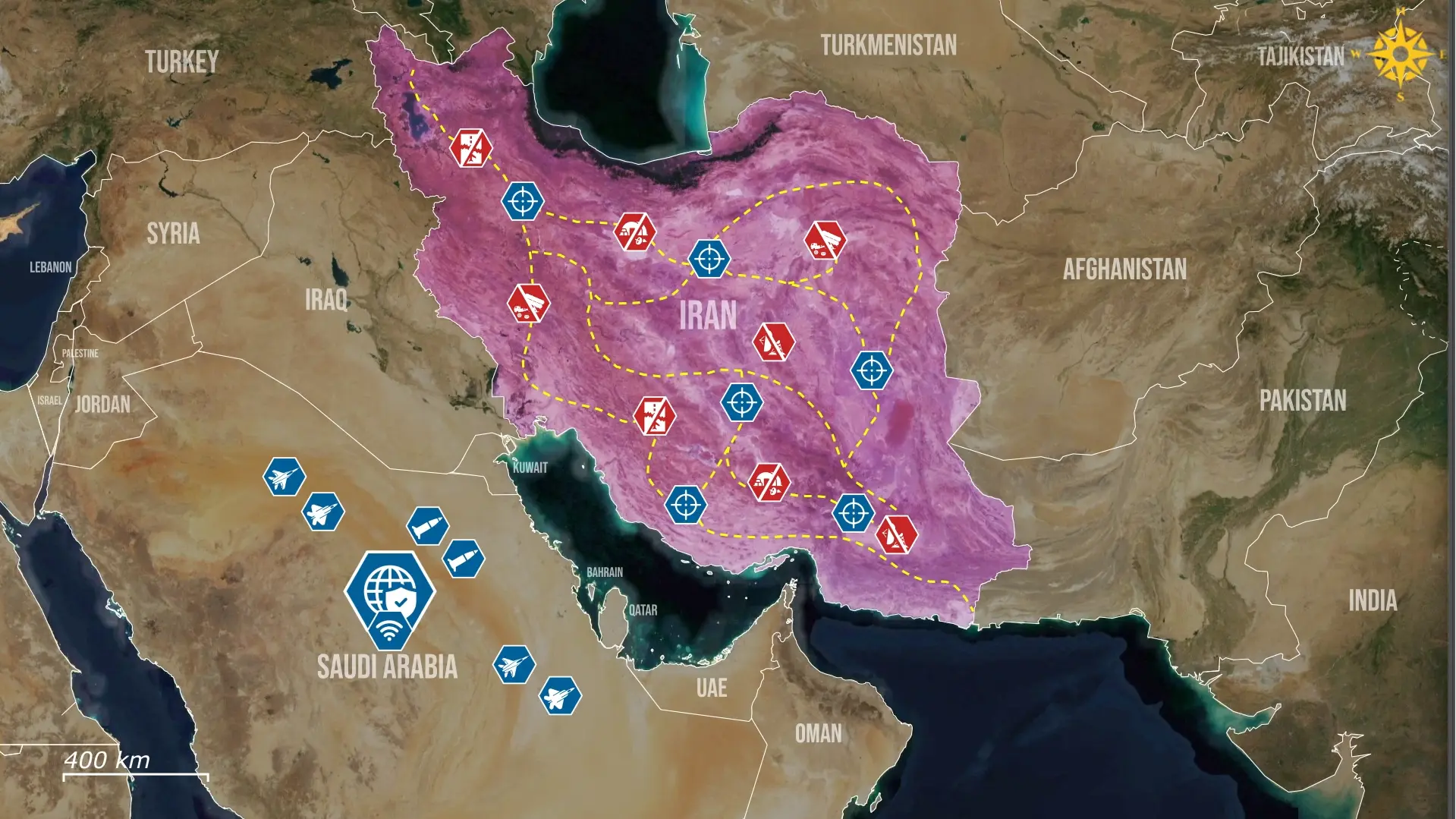

Integracja sztucznej inteligencji z procesem wskazywania celów oferuje przewagi taktyczne, które definiują wojnę na nowo. Pierwszą istotną zaletą jest skala dostępnych celów, ponieważ algorytmy potrafią przetwarzać dane znacznie szybciej niż człowiek. To z kolei umożliwia wysoką intensywność uderzeń, niemożliwą do osiągnięcia przy samej analizie ludzkiej. Dodatkowo system zintegrowany z AI oferuje większą głębię rażenia poprzez szybką identyfikację nie tylko aktywów stricte militarnych, ale także logistycznych, które mogą nie być oczywiste mimo swojego strategicznego znaczenia. Przewagi te znacząco zmieniają charakter wojny; dla armii takiej jak amerykańska czynnikiem ograniczającym nie jest już przetwarzanie danych wywiadowczych, lecz zdolność do wyprowadzania i podtrzymywania uderzeń.

Chociaż Pentagon formalnie deklaruje, że ostateczna decyzja należy do człowieka, tempo generowania propozycji celów przez maszyny spycha proces decyzyjny w stronę polegania na algorytmie. W rzeczywistości, mimo że oficerowie oficjalnie nadal pełnią rolę weryfikatorów zatwierdzających lub odrzucających uderzenia, mogą oni zostać skonfrontowani z setkami celów zweryfikowanych przez AI.

Jednocześnie znajdą się pod presją czasu, by działać, zanim przeciwnik zdoła zareagować. W rezultacie rola oficerów staje się coraz bardziej ograniczona do potwierdzania wielu proponowanych celów, zamiast przeprowadzania osobistej, ludzkiej i niuansowej oceny.

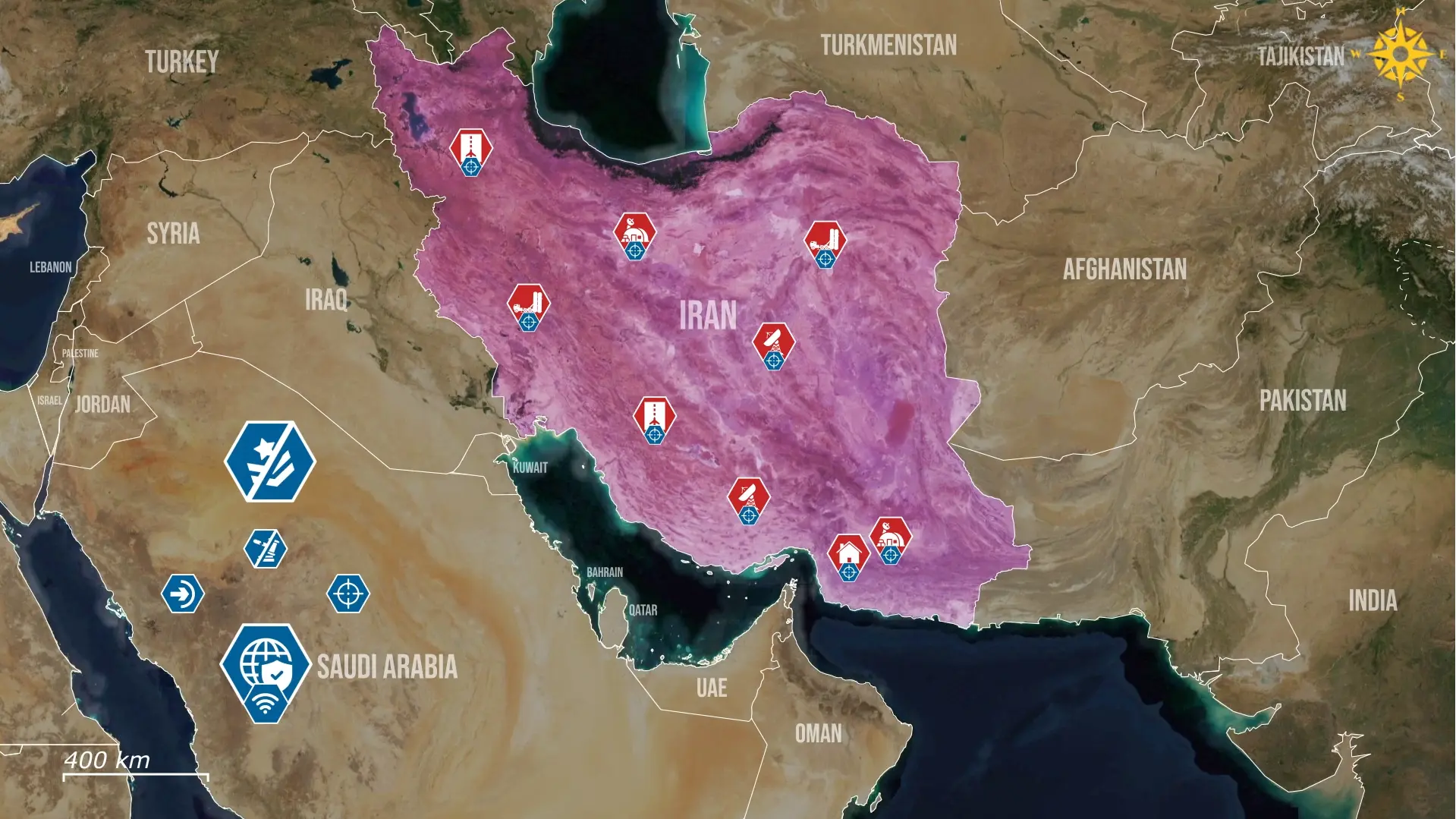

Jednakże, mimo że AI przetwarza informacje szybciej niż ludzie, nie jest ona z natury inteligentniejsza i może błędnie interpretować wzorce lub błędnie klasyfikować obiekty cywilne znajdujące się w pobliżu aktywów wojskowych. Przykładowo, raporty sugerują, że błąd identyfikacji wygenerowany przez AI mógł przyczynić się do zbombardowania szkoły dla dziewcząt sąsiadującej z irańskimi pozycjami wojskowymi w miejscowości Minab. Możliwość, że algorytm oznaczył to miejsce jako magazyn lub węzeł dowodzenia, podkreśla ryzyko strukturalne powstające, gdy ludzki nadzór staje się niewiele więcej niż formalnością. Błędy rozprzestrzeniają się również szybko w systemach zautomatyzowanych, zwłaszcza w operacjach opartych na szybkości, gdzie presja na zatwierdzanie celów jest wysoka. Utrzymanie rygorystycznej ludzkiej weryfikacji jest zatem niezbędne, aby zapobiec sytuacji, w której błędna klasyfikacja stanie się trwałą cechą cyklu celowniczego.

Ogólnie rzecz biorąc, integracja AI w działaniach wojennych reformuje równowagę między szybkością, precyzją a odpowiedzialnością, tworząc system zdolny do wywoływania efektów na dużą skalę przy minimalnej interwencji ludzkiej. Transformacja ta oferuje wyraźne korzyści operacyjne, lecz wprowadza także nowe podatności związane z błędną klasyfikacją, nadmiernym zaufaniem i rozmyciem ludzkiego osądu. Centralnym wyzwaniem będzie zaprojektowanie mechanizmów nadzoru, które dotrzymają kroku zautomatyzowanym cyklom decyzyjnym, zamiast pozostawać w tyle. Staje się to coraz ważniejsze w miarę rozszerzania przez siły zbrojne zastosowań AI na kolejne domeny i zacierania się odpowiedzialności prawnej.

.jpg)

Komentarze